Le danger des Deepfakes

En 2024, l’intelligence artificielle (IA) atteindra des sommets de réalisme par le biais des deepfake – des contenus audiovisuels générés par IA qui imitent de manière convaincante les personnes réelles, posant ainsi des cyber risques considérables. Ces outils sophistiqués servent souvent à des fins malveillantes telles que la désinformation, le vol d’identité et les cyberattaques. Tous les secteurs, de la finance à la santé, en incluant la politique et le divertissement, sont confrontés à la menace que représentent ces technologies trompeuses. Ces attaques de cybercriminalité évoluent sans cesse, passant d’opérations généralistes à des campagnes ciblées impliquant l’exfiltration de données avant le chiffrement. Les Deepfakes, améliorant le réalisme des attaques par ingénierie sociale, perfectionnent l’art de tromper les individus et compromettre la sécurité.

PODCAST

Vous manquez de temps ? Écoutez l’article !

L’article qui suit vise à démystifier les dangers des deepfakes et exposer les différentes manières dont ils remodèlent l’espace cybernétique. Nous aborderons l’impact des deepfakes sur la démocratie, leur rôle dans la cybercriminalité, et les mesures légales et réglementaires en réponse à ces menaces. Alors que l’utilisation malveillante des deepfakes dans les campagnes de désinformation s’accroît, l’accent sera mis sur la nécessité d’accroître la sensibilisation aux signes de manipulation médiatique et l’importance d’adopter des protocoles d’authentification. Tout en introduisant des technologies de détection avancées pour identifier la création de deepfakes, il est crucial d’explorer des solutions comme l’intelligence artificielle et la blockchain pour défendre l’intégrité des contenus médiatiques. Cet article a pour objet de fournir la connaissance et les stratégies nécessaires pour renforcer la protection contre les cyberattaques en 2024, une époque où la sécurité en ligne doit être une priorité pour toute entreprise.

Qu’est-ce qu’un deepfake ?

Les deepfakes, issus de la combinaison de l’apprentissage profond (deep learning) et des technologies de simulation (fake), sont des contenus audiovisuels manipulés par l’intelligence artificielle pour reproduire de manière convaincante des actions ou des discours qui ne se sont jamais produits. Ce phénomène représente des cyber risques non négligeables, notamment en raison de leur potentiel d’utilisation malveillante.

Création et Fonctionnement des Deepfakes :

- Utilisant des algorithmes avancés, les deepfakes sont générés par un réseau antagoniste génératif (GAN) composé de deux éléments clés : le générateur et le discriminateur.

- Le générateur crée des images ou des séquences audiovisuelles falsifiées, tandis que le discriminateur évalue leur authenticité. Ce processus itératif améliore la qualité des deepfakes jusqu’à les rendre difficilement distinguables de la réalité.

Applications et Conséquences :

- Bien que les deepfakes puissent servir à des fins bénéfiques, comme la reconstitution de voix ou d’images pour des personnalités disparues, leur potentiel de nuisance est considérable. Ils peuvent endommager des réputations, influencer l’opinion publique, violer la vie privée, interférer dans les processus électoraux et faciliter les fraudes et les escroqueries.

- Les premières recherches académiques sur cette technologie remontent aux années 1990. Cependant, elle est devenue plus accessible avec le développement d’applications de bureau propriétaires telles que FakeApp et des alternatives open-source comme Faceswap et DeepFaceLab.

Détection et prévention :

- Pour contrer cette menace, le développement d’algorithmes et de logiciels capables d’identifier les incohérences dans les contenus manipulés et de vérifier l’authenticité des contenus est crucial.

- Certains indicateurs de deepfakes incluent des erreurs de synchronisation labiale, un éclairage et des ombres inhabituels, des bords flous ou mal alignés, et des anomalies audio.

- Il est essentiel d’encourager la pensée critique et l’utilisation d’outils de détection de deepfakes pour évaluer l’authenticité des vidéos et autres contenus.

En 2024, la menace des deepfakes s’intensifie, rendant la sensibilisation et la protection contre ces attaques en ligne plus importantes que jamais pour toute entreprise. La mise en œuvre de mesures de sécurité et de protocoles d’authentification efficaces est donc essentielle pour préserver la sécurité de l’IA et contrer les dangers de la cybercriminalité.

L’impact des deepfakes sur la démocratie

L’impact des deepfakes sur la démocratie est multiple et profondément préoccupant. Voici quelques aspects clés de cette influence :

Influence sur les Croyances et les Élections :- Les deepfakes et les fausses nouvelles menacent la démocratie en induisant de fausses croyances, en détruisant la justification des croyances vraies et en empêchant les personnes d’acquérir de vraies croyances. Cette manipulation peut jouer sur les biais ancrés de grandes audiences, souvent diffusés via des plateformes de médias sociaux comme Facebook.

- Le potentiel des deepfakes pour influencer les résultats des élections est réel, surtout si l’attaquant distribue stratégiquement ces contenus manipulés. Ils ont déjà été utilisés pour manipuler l’opinion publique, discréditer des opposants et influencer les résultats des élections dans divers pays, comme l’Italie et le Bangladesh.

Menace pour les institutions démocratiques :

- Les fausses nouvelles, créées pour ressembler à de véritables informations, peuvent interférer avec les élections démocratiques et être utilisées comme propagande pour semer la division et le doute. De telles actions peuvent menacer le système judiciaire, influencer les procédures légales et détruire la confiance dans les institutions démocratiques.

Vulnérabilité des Femmes dans l’Espace Public :

- Les femmes, en particulier celles qui sont sous les feux de la rampe, sont vulnérables aux deepfakes qui peuvent être utilisés pour ternir leur réputation et les mettre en position compromettante, bien qu’erronée. Ce type d’attaque porte atteinte à la fois à l’individu, et à la perception de la légitimité des femmes dans les rôles de leadership et de décision.

En somme, la protection contre ces attaques en ligne est devenue un enjeu majeur pour la sécurité des démocraties en 2024. Il est impératif que les entreprises et les institutions démocratiques adoptent des mesures de sécurité et des protocoles d’authentification pour préserver l’intégrité de l’information et la confiance du public dans les systèmes démocratiques.

Deepfakes et cybercriminalité :

L’accessibilité croissante et la réduction des coûts des deepfakes alimentent leur utilisation dans le domaine de la cybercriminalité. Ces contenus trompeurs, exploitant des voix ou des vidéos réalistes de personnes, sont devenus des outils puissants pour manipuler la confiance et l’ingénierie sociale. Voici comment les deepfakes se manifestent dans le cyberespace :

Applications malveillantes des deepfakes :

- Nouvelles fausses : Diffusion de fausses informations pour manipuler l’opinion publique.

- Contrôle mental et escroqueries : Utilisation de vidéos ou d’audio convaincants pour influencer les comportements et extorquer des fonds.

- Fausse identification et fraude : Création de documents d’identité fictifs pour usurper des identités.

- Sextorsion : Chantage à l’aide de vidéos à caractère sexuel truquées pour nuire à la réputation des victimes.

L’e-mail demeure le vecteur privilégié pour les attaques par deepfake, impliqué dans 78 % des cas. Ces attaques peuvent entraîner des conséquences financières ou opérationnelles majeures pour les entreprises, telles que l’accès non autorisé aux réseaux et données, le vol financier et la perte d’informations confidentielles.

Pour prévenir et détecter ces menaces, il est impératif d’adopter des mesures telles que :

Éducation proactive :

Sensibilisation aux risques et formation pour reconnaître les signes de contenu manipulé.

Reconnaissance de signes suspects :

Surveillance des comportements inhabituels ou non caractéristiques.

Recherche d’indices visuels et audio :

Identification des erreurs de synchronisation labiale, de l’éclairage et des ombres anormales.

Réponse SIFT :

Stop (Arrêter), Investigate (Enquêter), Find (Trouver) et Trace (Tracer) pour évaluer l’authenticité des contenus.

Les efforts d’atténuation comprennent la mise à jour technologique, l’utilisation de l’authentification multi-facteurs, l’adoption d’une approche de sécurité « zéro confiance » et l’élaboration d’un plan de réponse aux incidents cybernétiques.

Les petites et moyennes entreprises (PME) sont particulièrement exposées aux risques de deepfakes, tels que les dommages à la réputation, les pertes financières et les violations de données. La démocratisation de l’intelligence artificielle abaisse les barrières à l’entrée pour les acteurs malveillants, menant à une augmentation des attaques cybernétiques sophistiquées, y compris celles impliquant des deepfakes.

Le paysage de la cybersécurité en 2024 sera marqué par d’importantes transformations, avec l’émergence de réglementations sur la vie privée, un changement vers une cybersécurité centrée sur l’humain et la complexité de la quantification du risque Cyber. Les vulnérabilités émergentes liées aux technologies de l’IA et de l’IoT soulignent l’importance de rester informé sur les menaces et d’employer des outils de détection avancés.

La réponse légale et réglementaire

Dans le contexte de l’émergence récente des deepfakes, les réponses légales et réglementaires sont encore en cours de développement, avec des approches variées selon les juridictions. Voici un aperçu des mesures prises à travers le monde :

États-Unis :

- Bien qu’il n’existe pas de législation fédérale spécifique, certains États ont adopté des lois ciblant principalement les élections et la pornographie non consensuelle créée par deepfake. Le DEEP FAKES Accountability Act est proposé pour exiger des créateurs de deepfakes qu’ils divulguent leur utilisation, interdire la distribution avec une intention malveillante et établir des amendes et peines d’emprisonnement pour les contrevenants.

Chine :

- La réglementation exige la divulgation de l’utilisation des deepfakes et interdit leur distribution sans avertissement clair, reflétant une position stricte sur la question.

Union européenne :

- Des régulations sont proposées, incluant l’étiquetage des médias synthétiques et la création d’un cadre légal pour le retrait des contenus manipulés.

Royaume-Uni :

- Initiatives pour contrer la menace des deepfakes, incluant le financement de la recherche en technologies de détection et la collaboration avec des institutions industrielles et académiques.

Inde :- Des lois existantes telles que la loi IT, le Copyright Act et le Data Protection Bill 2021 peuvent être appliquées aux cybercrimes liés aux deepfakes.

La mise en application de ces mesures se heurte toutefois à des défis, en raison de la nature mondiale et anonyme d’Internet. Cela souligne l’importance d’une approche proactive en matière de cybersécurité, incluant l’intégration d’expertise en cybersécurité au sein des conseils d’administration, l’avènement de programmes de confiance zéro et l’évolution du rôle des CISOs.

Pour équilibrer la protection des institutions démocratiques et la liberté d’expression, des solutions sont nécessaires, telles que les systèmes de détection basés sur l’IA, des politiques autour du retrait et de l’étiquetage des médias synthétiques et manipulés, des initiatives de littératie médiatique et des législations. Il est crucial de réguler l’utilisation des deepfakes et d’éduquer le public sur leurs risques et avantages potentiels pour prévenir les abus et promouvoir des applications positives, comme l’indique une réflexion sur l’utilité des deepfakes.

En résumé, face aux cyber risques que représentent les deepfakes en 2024, une réponse légale et réglementaire adaptée est essentielle pour la protection et la sécurité des individus et des entreprises. La législation doit évoluer avec la technologie pour procurer un cadre efficace contre les cyberattaques tout en préservant les libertés fondamentales.

Deepfakes au service du bien

Bien que les deepfakes soient souvent associés à des cyber risques et à des actes de cybercriminalité, ils possèdent également un potentiel significatif pour des applications bénéfiques dans divers secteurs. Voici quelques exemples illustrant comment les deepfakes peuvent être mis au service du bien :

Éducation :

- Animation de photos et de séquences historiques pour donner vie à l’histoire.

- Support personnalisé aux étudiants grâce à des avatars IA qui créent des expériences d’apprentissage immersives, avec des apparitions de figures historiques ou de scientifiques renommés

Service Client et Marketing :

- Utilisation d’avatars deepfake personnalisés pour les présentations et les conférences vidéo, notamment dans les métaverses.

- Contenus générés par IA pour personnaliser les actualités et les flux sportifs, améliorant ainsi l’expérience utilisateur et renforçant l’engagement client.

Accessibility:

- Aide aux personnes souffrant d’aphantasie, un trouble empêchant la création d’images mentales, grâce à la technologie pour construire ces images.

- Reconstruction de scènes de crime, fourniture d’anonymat pour les activistes des droits humains et les journalistes dans les régimes oppressifs, et expression en ligne pour les individus souhaitant préserver leur vie privée.

Secteur Médical :

- Réenactements historiques et outils d’apprentissage linguistique.

- Formation chirurgicale avancée et conception de prothèses personnalisées, permettant des interventions plus précises et adaptées aux patients.

Divertissement :

- Création d’effets spéciaux réalistes dans les films, les réalités virtuelles et les jeux vidéo, proposant une expérience plus immersive au public.

Petites et Moyennes Entreprises (PME) :- Marketing créatif, amélioration de l’expérience client et simulations de formation grâce à la technologie deepfake, ce qui peut être un atout considérable pour les PME innovantes.

Ces utilisations positives des deepfakes montrent que la technologie, lorsqu’elle est appliquée de manière éthique et responsable, peut contribuer à l’avancement de la société dans des domaines aussi variés que l’éducation, la santé et le divertissement. Toutefois, il est essentiel de continuer à développer des protocoles de sécurité et des mesures de protection pour s’assurer que les deepfakes restent un outil au service du bien et non un vecteur de cyberattaques ou de piratage.

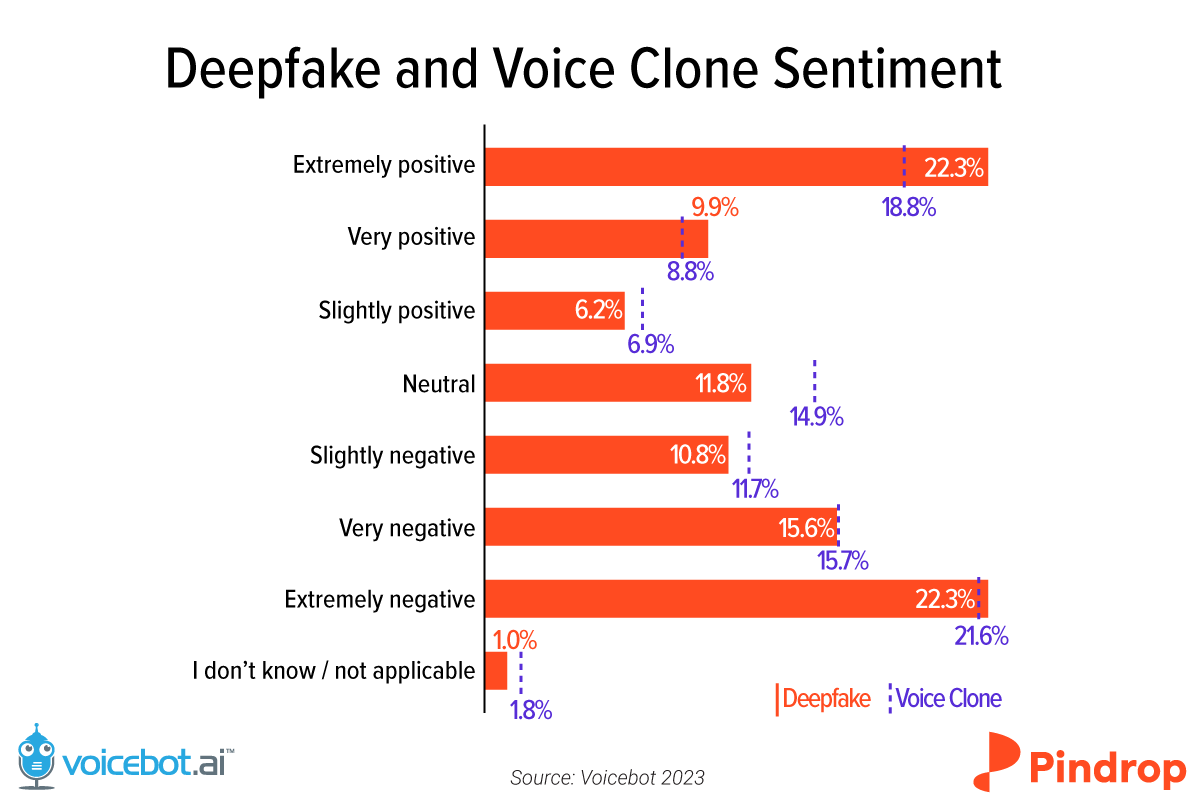

Source : Voicebot2023

Technologies de détection des deepfakes

Dans la lutte contre les cyber risques liés aux deepfakes en 2024, les technologies de détection jouent un rôle crucial. Voici quelques-unes des méthodes et des outils de pointe développés pour identifier et atténuer la menace des contenus médiatiques manipulés :

Analyse Audiovisuelle et Métadonnées :

- Utilisation de techniques sophistiquées pour analyser les caractéristiques faciales, les changements de couleur, les modèles de parole et les informations contextuelles, augmentant ainsi la précision de la détection des deepfakes audio et visuels.

Outils de Détection Basés sur l’IA :

- WeVerify : Cet outil intègre l’apprentissage automatique, les algorithmes d’IA, la reconnaissance faciale et une base de données publique basée sur la blockchain pour proposer une vérification multimodale, une analyse des réseaux sociaux et une vérification intelligente du contenu avec intervention humaine.

- Microsoft Video AI Authenticator : Développé par Microsoft Research et l’équipe Responsible AI, cet outil analyse les vidéos et les photos pour générer des scores de manipulation, détectant les changements subtils en niveaux de gris avec des scores de confiance en temps réel.

Solutions Avancées de Détection :- Sensity : Avec une précision supérieure à 95 %, cet outil détecte la technologie de diffusion utilisée par les frameworks IA et GAN avancés, identifiant les textes générés par des modèles de langage de grande envergure tels que ChatGPT.

- FakeCatcher d’Intel : Utilisant la photopléthysmographie (PPG), cet outil détecte les changements de flux sanguin et les mouvements des yeux, proposant un taux de précision de 96 % adapté aux entités traitant de grands volumes de contenu vidéo.

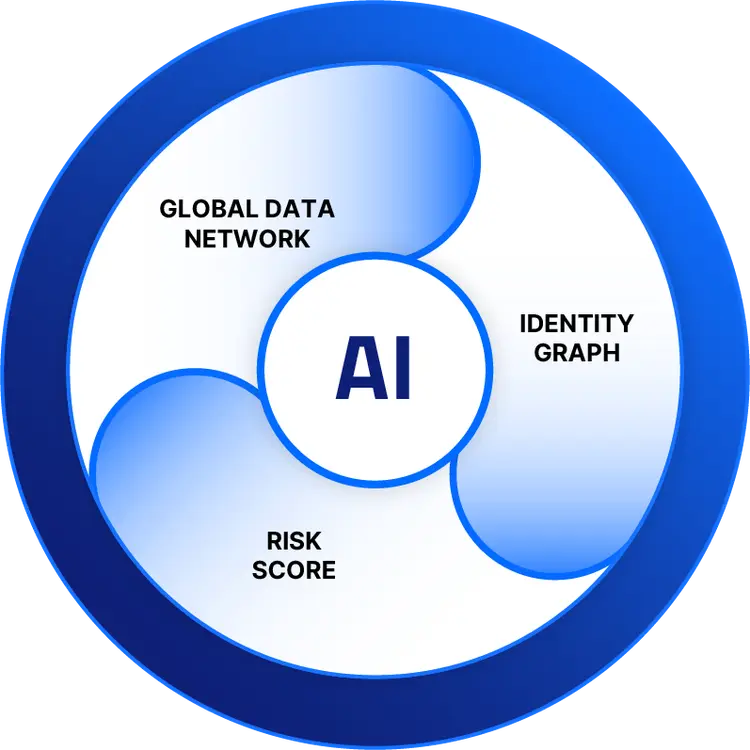

- Technologie de détection des deepfakes de Pindrop : Avec un taux de réussite de 99 %, elle crée un score de vivacité pour tous les appels, protégeant les entreprises contre les escroqueries par deepfake, en particulier les attaques survenant dans les centres d’appels. Pour comprendre comment fonctionne la détection des deepfakes de Pindrop, consultez Pindrop.

Les algorithmes de vérification peuvent détecter les images deepfake avec une grande précision, jusqu’à 99,97 % lors d’évaluations standard, assurant une information fiable et la protection des données personnelles en prévenant les attaques basées sur les deepfakes. Face à une demande croissante de techniques de validation pour discerner l’authenticité du contenu en ligne, y compris les deepfakes, les solutions technologiques, y compris les avancées en IA et en apprentissage automatique, sont cruciales pour combattre les menaces de deepfake.

Conclusion

Alors que nous naviguons dans le paysage numérique de 2024, les deepfakes présentent autant des possibilités prometteuses que des menaces redoutables. L’équilibre entre bénéficier de leur potentiel innovateur et le risque de manipulation et de déception requiert une vigilance constante. Les initiatives juridiques et technologiques, telles que la législation en émergence et les progrès dans la détection basée sur l’IA, indiquent une voie vers la protection contre les usages malveillants tout en préservant les libertés fondamentales. L’engagement collectif envers l’éducation et la sensibilisation par rapport à ces technologies est essentiel pour sécuriser l’espace cybernétique.

Face à ces défis, il incombe à chacun (institutions, entreprises et individus) de rester informés et préparés. Avec des outils de détection avancés et des protocoles d’authentification robustes, la communauté globale peut progresser vers un futur numérique plus sûr et plus transparent.